通用实例分割产线使用教程¶

1. 通用实例分割产线介绍¶

实例分割是一种计算机视觉任务,它不仅要识别图像中的物体类别,还要区分同一类别中不同实例的像素,从而实现对每个物体的精确分割。实例分割可以在同一图像中分别标记出每一辆车、每一个人或每一只动物,确保它们在像素级别上被独立处理。例如,在一幅包含多辆车和行人的街景图像中,实例分割能够将每辆车和每个人的轮廓清晰地分开,形成多个独立的区域标签。这项技术广泛应用于自动驾驶、视频监控和机器人视觉等领域,通常依赖于深度学习模型(如Mask R-CNN等),通过卷积神经网络来实现高效的像素分类和实例区分,为复杂场景的理解提供了强大的支持。本产线同时提供了灵活的服务化部署方式,支持在多种硬件上使用多种编程语言调用。不仅如此,本产线也提供了二次开发的能力,您可以基于本产线在您自己的数据集上训练调优,训练后的模型也可以无缝集成。

通用实例分割产线中包含了实例分割模块,该模块都包含多个模型,您可以根据下方的基准测试数据选择使用的模型。

通用实例分割产线中包含了实例分割模块,该模块都包含多个模型,您可以根据下方的基准测试数据选择使用的模型。

如果您更注重模型的精度,请选择精度较高的模型;如果您更在意模型的推理速度,请选择推理速度较快的模型;如果您关注模型的存储大小,请选择存储体积较小的模型。

通用图像实例分割模块(可选):

| 模型 | 模型下载链接 | Mask AP | GPU推理耗时(ms) [常规模式 / 高性能模式] |

CPU推理耗时(ms) [常规模式 / 高性能模式] |

模型存储大小(M) | 介绍 |

|---|---|---|---|---|---|---|

| Mask-RT-DETR-H | 推理模型/训练模型 | 50.6 | 172.36 / 172.36 | 1615.75 / 1615.75 | 449.9 M | Mask-RT-DETR 是一种基于RT-DETR的实例分割模型,通过采用最优性能的更好的PP-HGNetV2作为骨干网络,构建了MaskHybridEncoder编码器,引入了IOU-aware Query Selection 技术,使其在相同推理耗时上取得了SOTA实例分割精度。 |

| Mask-RT-DETR-L | 推理模型/训练模型 | 45.7 | 88.18 / 88.18 | 1090.84 / 1090.84 | 113.6 M |

❗ 以上列出的是实例分割模块重点支持的2个核心模型,该模块总共支持15个模型,完整的模型列表如下:

👉模型列表详情

| 模型 | 模型下载链接 | Mask AP | GPU推理耗时(ms) [常规模式 / 高性能模式] |

CPU推理耗时(ms) [常规模式 / 高性能模式] |

模型存储大小(M) | 介绍 |

|---|---|---|---|---|---|---|

| Cascade-MaskRCNN-ResNet50-FPN | 推理模型/训练模型 | 36.3 | 141.69 / 141.69 | 254.8 M | Cascade-MaskRCNN 是一种改进的Mask RCNN实例分割模型,通过级联多个检测器,利用不同IOU阈值优化分割结果,解决检测与推理阶段的mismatch问题,提高了实例分割的准确性。 | |

| Cascade-MaskRCNN-ResNet50-vd-SSLDv2-FPN | 推理模型/训练模型 | 39.1 | 147.62 / 147.62 | 254.7 M | ||

| Mask-RT-DETR-H | 推理模型/训练模型 | 50.6 | 172.36 / 172.36 | 1615.75 / 1615.75 | 449.9 M | Mask-RT-DETR 是一种基于RT-DETR的实例分割模型,通过采用最优性能的更好的PP-HGNetV2作为骨干网络,构建了MaskHybridEncoder编码器,引入了IOU-aware Query Selection 技术,使其在相同推理耗时上取得了SOTA实例分割精度。 |

| Mask-RT-DETR-L | 推理模型/训练模型 | 45.7 | 88.18 / 88.18 | 1090.84 / 1090.84 | 113.6 M | |

| Mask-RT-DETR-M | 推理模型/训练模型 | 42.7 | 78.69 / 78.69 | 66.6 M | ||

| Mask-RT-DETR-S | 推理模型/训练模型 | 41.0 | 33.5007 | - | 51.8 M | |

| Mask-RT-DETR-X | 推理模型/训练模型 | 47.5 | 114.16 / 114.16 | 1240.92 / 1240.92 | 237.5 M | |

| MaskRCNN-ResNet50-FPN | 推理模型/训练模型 | 35.6 | 118.30 / 118.30 | 157.5 M | Mask R-CNN是由华盛顿首例即现投影卡的一个全任务深度学习模型,能够在一个模型中完成图片实例的分类和定位,并结合图像级的遮罩(Mask)来完成分割任务。 | |

| MaskRCNN-ResNet50-vd-FPN | 推理模型/训练模型 | 36.4 | 118.34 / 118.34 | 157.5 M | ||

| MaskRCNN-ResNet50 | 推理模型/训练模型 | 32.8 | 228.83 / 228.83 | 128.7 M | ||

| MaskRCNN-ResNet101-FPN | 推理模型/训练模型 | 36.6 | 148.14 / 148.14 | 225.4 M | ||

| MaskRCNN-ResNet101-vd-FPN | 推理模型/训练模型 | 38.1 | 151.12 / 151.12 | 225.1 M | ||

| MaskRCNN-ResNeXt101-vd-FPN | 推理模型/训练模型 | 39.5 | 237.55 / 237.55 | 370.0 M | ||

| PP-YOLOE_seg-S | 推理模型/训练模型 | 32.5 | - | - | 31.5 M | PP-YOLOE_seg 是一种基于PP-YOLOE的实例分割模型。该模型沿用了PP-YOLOE的backbone和head,通过设计PP-YOLOE实例分割头,大幅提升了实例分割的性能和推理速度。 |

| SOLOv2 | 推理模型/训练模型 | 35.5 | - | - | 179.1 M | SOLOv2 是一种按位置分割物体的实时实例分割算法。该模型是SOLO的改进版本,通过引入掩码学习和掩码NMS,实现了精度和速度上取得良好平衡。 |

- 性能测试环境

- 测试数据集: COCO2017验证集。

- 硬件配置:

- GPU:NVIDIA Tesla T4

- CPU:Intel Xeon Gold 6271C @ 2.60GHz

- 其他环境:Ubuntu 20.04 / cuDNN 8.6 / TensorRT 8.5.2.2

- 推理模式说明

| 模式 | GPU配置 | CPU配置 | 加速技术组合 |

|---|---|---|---|

| 常规模式 | FP32精度 / 无TRT加速 | FP32精度 / 8线程 | PaddleInference |

| 高性能模式 | 选择先验精度类型和加速策略的最优组合 | FP32精度 / 8线程 | 选择先验最优后端(Paddle/OpenVINO/TRT等) |

2. 快速开始¶

PaddleX 所提供的模型产线均可以快速体验效果,你可以在星河社区线体验通用 实例分割 产线的效果,也可以在本地使用命令行或 Python 体验通用 实例分割 产线的效果。

2.1 在线体验¶

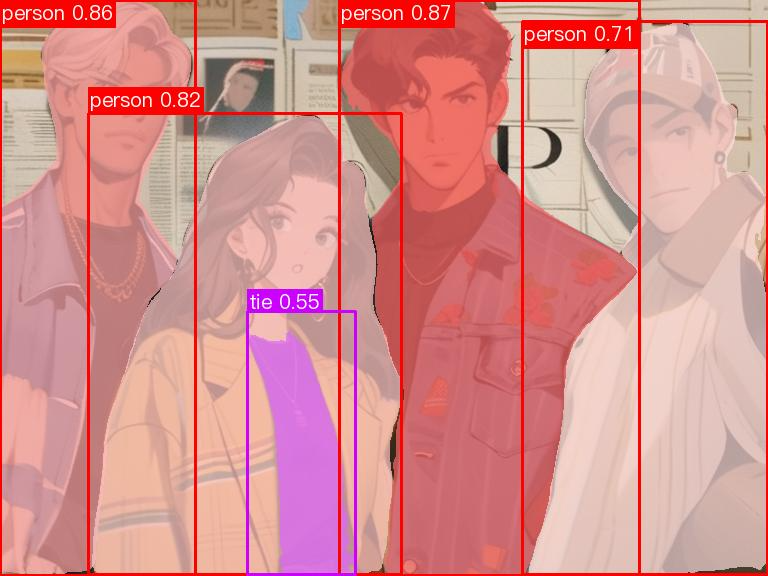

您可以在线体验通用实例分割产线的效果,用官方提供的 demo 图片进行识别,例如:

如果您对产线运行的效果满意,可以直接进行集成部署。您可以选择从云端下载部署包,也可以参考2.2节本地体验中的方法进行本地部署。如果对效果不满意,您可以利用私有数据对产线中的模型进行微调训练。如果您具备本地训练的硬件资源,可以直接在本地开展训练;如果没有,星河零代码平台提供了一键式训练服务,无需编写代码,只需上传数据后,即可一键启动训练任务。

2.2 本地体验¶

❗ 在本地使用通用实例分割产线前,请确保您已经按照PaddleX本地安装教程完成了PaddleX的wheel包安装。

2.2.1 命令行方式体验¶

- 一行命令即可快速体验实例分割产线效果,使用 测试文件,并将

--input替换为本地路径,进行预测

paddlex --pipeline instance_segmentation \

--input general_instance_segmentation_004.png \

--threshold 0.5 \

--save_path ./output \

--device gpu:0

运行后,会将结果打印到终端上,结果如下:

{'res': {'input_path': 'general_instance_segmentation_004.png', 'page_index': None, 'boxes': [{'cls_id': 0, 'label': 'person', 'score': 0.8695873022079468, 'coordinate': [339.83426, 0, 639.8651, 575.22003]}, {'cls_id': 0, 'label': 'person', 'score': 0.8572642803192139, 'coordinate': [0.09976959, 0, 195.07274, 575.358]}, {'cls_id': 0, 'label': 'person', 'score': 0.8201770186424255, 'coordinate': [88.24664, 113.422424, 401.23077, 574.70197]}, {'cls_id': 0, 'label': 'person', 'score': 0.7110118269920349, 'coordinate': [522.54065, 21.457964, 767.5007, 574.2464]}, {'cls_id': 27, 'label': 'tie', 'score': 0.5543721914291382, 'coordinate': [247.38776, 312.4094, 355.2685, 574.1264]}], 'masks': '...'}}

可视化结果保存在save_path下,其中实例分割的可视化结果如下:

2.2.2 Python脚本方式集成¶

- 上述命令行是为了快速体验查看效果,一般来说,在项目中,往往需要通过代码集成,您可以通过几行代码即可完成产线的快速推理,推理代码如下:

from paddlex import create_pipeline

pipeline = create_pipeline(pipeline="instance_segmentation")

output = pipeline.predict(input="general_instance_segmentation_004.png", threshold=0.5)

for res in output:

res.print()

res.save_to_img(save_path="./output/")

res.save_to_json(save_path="./output/")

在上述 Python 脚本中,执行了如下几个步骤:

(1)通过 create_pipeline() 实例化 实例分割 产线对象,具体参数说明如下:

| 参数 | 参数说明 | 参数类型 | 默认值 |

|---|---|---|---|

pipeline |

产线名称或是产线配置文件路径。如为产线名称,则必须为 PaddleX 所支持的产线。 | str |

None |

config |

产线具体的配置信息(如果和pipeline同时设置,优先级高于pipeline,且要求产线名和pipeline一致)。 |

dict[str, Any] |

None |

device |

产线推理设备。支持指定GPU具体卡号,如“gpu:0”,其他硬件具体卡号,如“npu:0”,CPU如“cpu”。 | str |

None |

use_hpip |

是否启用高性能推理,仅当该产线支持高性能推理时可用。 | bool |

False |

(2)调用 实例分割 产线对象的 predict() 方法进行推理预测。该方法将返回一个 generator。以下是 predict() 方法的参数及其说明:

| 参数 | 参数说明 | 参数类型 | 可选项 | 默认值 |

|---|---|---|---|---|

input |

待预测数据,支持多种输入类型,必填 | Python Var|str|list |

|

None |

device |

产线推理设备 | str|None |

|

None |

threshold |

模型的低分object过滤阈值 | float|None |

|

None |

(3)对预测结果进行处理,每个样本的预测结果均为对应的Result对象,且支持打印、保存为图片、保存为json文件的操作:

| 方法 | 方法说明 | 参数 | 参数类型 | 参数说明 | 默认值 |

|---|---|---|---|---|---|

print() |

打印结果到终端 | format_json |

bool |

是否对输出内容进行使用 JSON 缩进格式化 |

True |

indent |

int |

指定缩进级别,以美化输出的 JSON 数据,使其更具可读性,仅当 format_json 为 True 时有效 |

4 | ||

ensure_ascii |

bool |

控制是否将非 ASCII 字符转义为 Unicode。设置为 True 时,所有非 ASCII 字符将被转义;False 则保留原始字符,仅当format_json为True时有效 |

False |

||

save_to_json() |

将结果保存为json格式的文件 | save_path |

str |

保存的文件路径,当为目录时,保存文件命名与输入文件类型命名一致 | 无 |

indent |

int |

指定缩进级别,以美化输出的 JSON 数据,使其更具可读性,仅当 format_json 为 True 时有效 |

4 | ||

ensure_ascii |

bool |

控制是否将非 ASCII 字符转义为 Unicode。设置为 True 时,所有非 ASCII 字符将被转义;False 则保留原始字符,仅当format_json为True时有效 |

False |

||

save_to_img() |

将结果保存为图像格式的文件 | save_path |

str |

保存的文件路径,支持目录或文件路径 | 无 |

-

调用

print()方法会将结果打印到终端,打印到终端的内容解释如下:-

input_path:(str)待预测图像的输入路径 -

page_index:(Union[int, None])如果输入是PDF文件,则表示当前是PDF的第几页,否则为None -

boxes:(list)检测框信息,每个元素为一个字典,包含以下字段: cls_id:(int)类别IDlabel:(str)类别名称score:(float)检测框的置信度-

coordinate:(list)检测框的坐标,格式为[xmin, ymin, xmax, ymax] -

masks:...实例分割模型实际预测的mask,由于数据过大不便于直接print,因此用...替换,可以通过res.save_to_img将预测结果保存为图片,通过res.save_to_json将预测结果保存为json文件。

-

-

调用

save_to_json()方法会将上述内容保存到指定的save_path中,如果指定为目录,则保存的路径为save_path/{your_img_basename}_res.json,如果指定为文件,则直接保存到该文件中。由于json文件不支持保存numpy数组,因此会将其中的numpy.array类型转换为列表形式。 -

调用

save_to_img()方法会将可视化结果保存到指定的save_path中,如果指定为目录,则保存的路径为save_path/{your_img_basename}_res.{your_img_extension},如果指定为文件,则直接保存到该文件中。 -

此外,也支持通过属性获取带结果的可视化图像和预测结果,具体如下:

| 属性 | 属性说明 |

|---|---|

json |

获取预测的 json 格式的结果 |

img |

获取格式为 dict 的可视化图像 |

json属性获取的预测结果为dict类型的数据,相关内容与调用save_to_json()方法保存的内容一致。img属性返回的预测结果是一个字典类型的数据。其中,键为res, 对应的值是一个Image.Image对象:一个用于显示 实例分割 的预测结果。

此外,您可以获取 实例分割 产线配置文件,并加载配置文件进行预测。可执行如下命令将结果保存在 my_path 中:

若您获取了配置文件,即可对实例分割产线各项配置进行自定义,只需要修改 create_pipeline 方法中的 pipeline 参数值为产线配置文件路径即可。示例如下:

from paddlex import create_pipeline

pipeline = create_pipeline(pipeline="./my_path/instance_segmentation.yaml")

output = pipeline.predict(

input="./general_instance_segmentation_004.png",

threshold=0.5,

)

for res in output:

res.print()

res.save_to_img("./output/")

res.save_to_json("./output/")

注: 配置文件中的参数为产线初始化参数,如果希望更改通用实例分割产线初始化参数,可以直接修改配置文件中的参数,并加载配置文件进行预测。同时,CLI 预测也支持传入配置文件,--pipeline 指定配置文件的路径即可。

3. 开发集成/部署¶

如果产线可以达到您对产线推理速度和精度的要求,您可以直接进行开发集成/部署。

若您需要将产线直接应用在您的Python项目中,可以参考 2.2.2 Python脚本方式中的示例代码。

此外,PaddleX 也提供了其他三种部署方式,详细说明如下:

🚀 高性能推理:在实际生产环境中,许多应用对部署策略的性能指标(尤其是响应速度)有着较严苛的标准,以确保系统的高效运行与用户体验的流畅性。为此,PaddleX 提供高性能推理插件,旨在对模型推理及前后处理进行深度性能优化,实现端到端流程的显著提速,详细的高性能推理流程请参考PaddleX高性能推理指南。

☁️ 服务化部署:服务化部署是实际生产环境中常见的一种部署形式。通过将推理功能封装为服务,客户端可以通过网络请求来访问这些服务,以获取推理结果。PaddleX 支持多种产线服务化部署方案,详细的产线服务化部署流程请参考PaddleX服务化部署指南。

以下是基础服务化部署的API参考与多语言服务调用示例:

API参考

对于服务提供的主要操作:

- HTTP请求方法为POST。

- 请求体和响应体均为JSON数据(JSON对象)。

- 当请求处理成功时,响应状态码为

200,响应体的属性如下:

| 名称 | 类型 | 含义 |

|---|---|---|

logId |

string |

请求的UUID。 |

errorCode |

integer |

错误码。固定为0。 |

errorMsg |

string |

错误说明。固定为"Success"。 |

result |

object |

操作结果。 |

- 当请求处理未成功时,响应体的属性如下:

| 名称 | 类型 | 含义 |

|---|---|---|

logId |

string |

请求的UUID。 |

errorCode |

integer |

错误码。与响应状态码相同。 |

errorMsg |

string |

错误说明。 |

服务提供的主要操作如下:

infer

对图像进行实例分割。

POST /instance-segmentation

- 请求体的属性如下:

| 名称 | 类型 | 含义 | 是否必填 |

|---|---|---|---|

image |

string |

服务器可访问的图像文件的URL或图像文件内容的Base64编码结果。 | 是 |

threshold |

number | null |

请参阅产线对象中 predict 方法的 threshold 参数相关说明。 |

否 |

- 请求处理成功时,响应体的

result具有如下属性:

| 名称 | 类型 | 含义 |

|---|---|---|

instances |

array |

实例的位置、类别等信息。 |

image |

string | null |

实例分割结果图。图像为JPEG格式,使用Base64编码。 |

instances中的每个元素为一个object,具有如下属性:

| 名称 | 类型 | 含义 |

|---|---|---|

bbox |

array |

实例位置。数组中元素依次为边界框左上角x坐标、左上角y坐标、右下角x坐标以及右下角y坐标。 |

categoryId |

integer |

实例类别ID。 |

categoryName |

string |

实例类别标签名。 |

score |

number |

实例得分。 |

mask |

object |

实例的分割掩膜。 |

mask的属性如下:

| 名称 | 类型 | 含义 |

|---|---|---|

rleResult |

str |

掩膜的游程编码结果。 |

size |

array |

掩膜的形状。数组中元素依次为掩膜的高度和宽度。 |

result示例如下:

{

"instances": [

{

"bbox": [

162.39381408691406,

83.88176727294922,

624.0797119140625,

343.4986877441406

],

"categoryId": 33,

"score": 0.8691174983978271,

"mask": {

"rleResult": "xxxxxx",

"size": [

259,

462

]

}

}

],

"image": "xxxxxx"

}

多语言调用服务示例

Python

import base64

import requests

API_URL = "http://localhost:8080/instance-segmentation" # 服务URL

image_path = "./demo.jpg"

output_image_path = "./out.jpg"

# 对本地图像进行Base64编码

with open(image_path, "rb") as file:

image_bytes = file.read()

image_data = base64.b64encode(image_bytes).decode("ascii")

payload = {"image": image_data} # Base64编码的文件内容或者图像URL

# 调用API

response = requests.post(API_URL, json=payload)

# 处理接口返回数据

assert response.status_code == 200

result = response.json()["result"]

with open(output_image_path, "wb") as file:

file.write(base64.b64decode(result["image"]))

print(f"Output image saved at {output_image_path}")

print("\nInstances:")

print(result["instances"])

C++

#include <iostream>

#include "cpp-httplib/httplib.h" // https://github.com/Huiyicc/cpp-httplib

#include "nlohmann/json.hpp" // https://github.com/nlohmann/json

#include "base64.hpp" // https://github.com/tobiaslocker/base64

int main() {

httplib::Client client("localhost:8080");

const std::string imagePath = "./demo.jpg";

const std::string outputImagePath = "./out.jpg";

httplib::Headers headers = {

{"Content-Type", "application/json"}

};

// 对本地图像进行Base64编码

std::ifstream file(imagePath, std::ios::binary | std::ios::ate);

std::streamsize size = file.tellg();

file.seekg(0, std::ios::beg);

std::vector<char> buffer(size);

if (!file.read(buffer.data(), size)) {

std::cerr << "Error reading file." << std::endl;

return 1;

}

std::string bufferStr(reinterpret_cast<const char*>(buffer.data()), buffer.size());

std::string encodedImage = base64::to_base64(bufferStr);

nlohmann::json jsonObj;

jsonObj["image"] = encodedImage;

std::string body = jsonObj.dump();

// 调用API

auto response = client.Post("/instance-segmentation", headers, body, "application/json");

// 处理接口返回数据

if (response && response->status == 200) {

nlohmann::json jsonResponse = nlohmann::json::parse(response->body);

auto result = jsonResponse["result"];

encodedImage = result["image"];

std::string decodedString = base64::from_base64(encodedImage);

std::vector<unsigned char> decodedImage(decodedString.begin(), decodedString.end());

std::ofstream outputImage(outPutImagePath, std::ios::binary | std::ios::out);

if (outputImage.is_open()) {

outputImage.write(reinterpret_cast<char*>(decodedImage.data()), decodedImage.size());

outputImage.close();

std::cout << "Output image saved at " << outPutImagePath << std::endl;

} else {

std::cerr << "Unable to open file for writing: " << outPutImagePath << std::endl;

}

auto instances = result["instances"];

std::cout << "\nInstances:" << std::endl;

for (const auto& inst : instances) {

std::cout << inst << std::endl;

}

} else {

std::cout << "Failed to send HTTP request." << std::endl;

return 1;

}

return 0;

}

Java

import okhttp3.*;

import com.fasterxml.jackson.databind.ObjectMapper;

import com.fasterxml.jackson.databind.JsonNode;

import com.fasterxml.jackson.databind.node.ObjectNode;

import java.io.File;

import java.io.FileOutputStream;

import java.io.IOException;

import java.util.Base64;

public class Main {

public static void main(String[] args) throws IOException {

String API_URL = "http://localhost:8080/instance-segmentation"; // 服务URL

String imagePath = "./demo.jpg"; // 本地图像

String outputImagePath = "./out.jpg"; // 输出图像

// 对本地图像进行Base64编码

File file = new File(imagePath);

byte[] fileContent = java.nio.file.Files.readAllBytes(file.toPath());

String imageData = Base64.getEncoder().encodeToString(fileContent);

ObjectMapper objectMapper = new ObjectMapper();

ObjectNode params = objectMapper.createObjectNode();

params.put("image", imageData); // Base64编码的文件内容或者图像URL

// 创建 OkHttpClient 实例

OkHttpClient client = new OkHttpClient();

MediaType JSON = MediaType.Companion.get("application/json; charset=utf-8");

RequestBody body = RequestBody.Companion.create(params.toString(), JSON);

Request request = new Request.Builder()

.url(API_URL)

.post(body)

.build();

// 调用API并处理接口返回数据

try (Response response = client.newCall(request).execute()) {

if (response.isSuccessful()) {

String responseBody = response.body().string();

JsonNode resultNode = objectMapper.readTree(responseBody);

JsonNode result = resultNode.get("result");

String base64Image = result.get("image").asText();

JsonNode instances = result.get("instances");

byte[] imageBytes = Base64.getDecoder().decode(base64Image);

try (FileOutputStream fos = new FileOutputStream(outputImagePath)) {

fos.write(imageBytes);

}

System.out.println("Output image saved at " + outputImagePath);

System.out.println("\nInstances: " + instances.toString());

} else {

System.err.println("Request failed with code: " + response.code());

}

}

}

}

Go

package main

import (

"bytes"

"encoding/base64"

"encoding/json"

"fmt"

"io/ioutil"

"net/http"

)

func main() {

API_URL := "http://localhost:8080/instance-segmentation"

imagePath := "./demo.jpg"

outputImagePath := "./out.jpg"

// 对本地图像进行Base64编码

imageBytes, err := ioutil.ReadFile(imagePath)

if err != nil {

fmt.Println("Error reading image file:", err)

return

}

imageData := base64.StdEncoding.EncodeToString(imageBytes)

payload := map[string]string{"image": imageData} // Base64编码的文件内容或者图像URL

payloadBytes, err := json.Marshal(payload)

if err != nil {

fmt.Println("Error marshaling payload:", err)

return

}

// 调用API

client := &http.Client{}

req, err := http.NewRequest("POST", API_URL, bytes.NewBuffer(payloadBytes))

if err != nil {

fmt.Println("Error creating request:", err)

return

}

res, err := client.Do(req)

if err != nil {

fmt.Println("Error sending request:", err)

return

}

defer res.Body.Close()

// 处理接口返回数据

body, err := ioutil.ReadAll(res.Body)

if err != nil {

fmt.Println("Error reading response body:", err)

return

}

type Response struct {

Result struct {

Image string `json:"image"`

Instances []map[string]interface{} `json:"instances"`

} `json:"result"`

}

var respData Response

err = json.Unmarshal([]byte(string(body)), &respData)

if err != nil {

fmt.Println("Error unmarshaling response body:", err)

return

}

outputImageData, err := base64.StdEncoding.DecodeString(respData.Result.Image)

if err != nil {

fmt.Println("Error decoding base64 image data:", err)

return

}

err = ioutil.WriteFile(outputImagePath, outputImageData, 0644)

if err != nil {

fmt.Println("Error writing image to file:", err)

return

}

fmt.Printf("Image saved at %s.jpg\n", outputImagePath)

fmt.Println("\nInstances:")

for _, inst := range respData.Result.Instances {

fmt.Println(inst)

}

}

C#

using System;

using System.IO;

using System.Net.Http;

using System.Net.Http.Headers;

using System.Text;

using System.Threading.Tasks;

using Newtonsoft.Json.Linq;

class Program

{

static readonly string API_URL = "http://localhost:8080/instance-segmentation";

static readonly string imagePath = "./demo.jpg";

static readonly string outputImagePath = "./out.jpg";

static async Task Main(string[] args)

{

var httpClient = new HttpClient();

// 对本地图像进行Base64编码

byte[] imageBytes = File.ReadAllBytes(imagePath);

string image_data = Convert.ToBase64String(imageBytes);

var payload = new JObject{ { "image", image_data } }; // Base64编码的文件内容或者图像URL

var content = new StringContent(payload.ToString(), Encoding.UTF8, "application/json");

// 调用API

HttpResponseMessage response = await httpClient.PostAsync(API_URL, content);

response.EnsureSuccessStatusCode();

// 处理接口返回数据

string responseBody = await response.Content.ReadAsStringAsync();

JObject jsonResponse = JObject.Parse(responseBody);

string base64Image = jsonResponse["result"]["image"].ToString();

byte[] outputImageBytes = Convert.FromBase64String(base64Image);

File.WriteAllBytes(outputImagePath, outputImageBytes);

Console.WriteLine($"Output image saved at {outputImagePath}");

Console.WriteLine("\nInstances:");

Console.WriteLine(jsonResponse["result"]["instances"].ToString());

}

}

Node.js

const axios = require('axios');

const fs = require('fs');

const API_URL = 'http://localhost:8080/instance-segmentation'

const imagePath = './demo.jpg'

const outputImagePath = "./out.jpg";

let config = {

method: 'POST',

maxBodyLength: Infinity,

url: API_URL,

data: JSON.stringify({

'image': encodeImageToBase64(imagePath) // Base64编码的文件内容或者图像URL

})

};

// 对本地图像进行Base64编码

function encodeImageToBase64(filePath) {

const bitmap = fs.readFileSync(filePath);

return Buffer.from(bitmap).toString('base64');

}

// 调用API

axios.request(config)

.then((response) => {

// 处理接口返回数据

const result = response.data["result"];

const imageBuffer = Buffer.from(result["image"], 'base64');

fs.writeFile(outputImagePath, imageBuffer, (err) => {

if (err) throw err;

console.log(`Output image saved at ${outputImagePath}`);

});

console.log("\nInstances:");

console.log(result["instances"]);

})

.catch((error) => {

console.log(error);

});

PHP

<?php

$API_URL = "http://localhost:8080/instance-segmentation"; // 服务URL

$image_path = "./demo.jpg";

$output_image_path = "./out.jpg";

// 对本地图像进行Base64编码

$image_data = base64_encode(file_get_contents($image_path));

$payload = array("image" => $image_data); // Base64编码的文件内容或者图像URL

// 调用API

$ch = curl_init($API_URL);

curl_setopt($ch, CURLOPT_POST, true);

curl_setopt($ch, CURLOPT_POSTFIELDS, json_encode($payload));

curl_setopt($ch, CURLOPT_HTTPHEADER, array('Content-Type: application/json'));

curl_setopt($ch, CURLOPT_RETURNTRANSFER, true);

$response = curl_exec($ch);

curl_close($ch);

// 处理接口返回数据

$result = json_decode($response, true)["result"];

file_put_contents($output_image_path, base64_decode($result["image"]));

echo "Output image saved at " . $output_image_path . "\n";

echo "\nInstances:\n";

print_r($result["instances"]);

?>

📱 端侧部署:端侧部署是一种将计算和数据处理功能放在用户设备本身上的方式,设备可以直接处理数据,而不需要依赖远程的服务器。PaddleX 支持将模型部署在 Android 等端侧设备上,详细的端侧部署流程请参考PaddleX端侧部署指南。 您可以根据需要选择合适的方式部署模型产线,进而进行后续的 AI 应用集成。

4. 二次开发¶

如果通用实例分割产线提供的默认模型权重在您的场景中,精度或速度不满意,您可以尝试利用您自己拥有的特定领域或应用场景的数据对现有模型进行进一步的微调,以提升通用实例分割产线的在您的场景中的识别效果。

4.1 模型微调¶

由于通用实例分割产线包含实例分割模块,如果模型产线的效果不及预期,您可以对分割效果差的图片进行分析,并参考以下表格中对应的微调教程链接进行模型微调。

| 情形 | 微调模块 | 微调参考链接 |

|---|---|---|

| 预测结果不达预期 | 实例分割模块 | 链接 |

4.2 模型应用¶

当您使用私有数据集完成微调训练后,可获得本地模型权重文件。

若您需要使用微调后的模型权重,只需对产线配置文件做修改,将微调后模型权重的本地路径替换至产线配置文件中的对应位置即可:

SubModules:

InstanceSegmentation:

module_name: instance_segmentation

model_name: Mask-RT-DETR-S

model_dir: null # 替换为微调后的实例分割模型权重路径

batch_size: 1

threshold: 0.5

5. 多硬件支持¶

PaddleX 支持英伟达 GPU、昆仑芯 XPU、昇腾 NPU和寒武纪 MLU 等多种主流硬件设备,仅需修改 --device参数即可完成不同硬件之间的无缝切换。

例如,您使用昇腾 NPU 进行 实例分割 产线的推理,使用的 CLI 命令为:

paddlex --pipeline instance_segmentation \

--input general_instance_segmentation_004.png \

--threshold 0.5 \

--save_path ./output \

--device npu:0

当然,您也可以在 Python 脚本中 create_pipeline() 时或者 predict() 时指定硬件设备。

若您想在更多种类的硬件上使用通用实例分割产线,请参考PaddleX多硬件使用指南。